过年期间,我收到了 DeepSeek 的消息,立刻去体验了一番。这个工具通过深度思考的方式提供了详细的思考过程,让我更容易纠正模型的输出。当时我马上把它推荐给了我哥,他的惊讶就像我第一次见到飞机时一样。之前,国内的大模型体验确实不太理想,所以我一直通过梯子使用 ChatGPT。不过,这个服务用多了需要付费,而且调用 API 还得用国外的手机号来接收验证码,所以一直没有深入使用。

这次 DeepSeek 的出现让我非常兴奋,它禁用了 +86 以外的手机号注册,终于有了一次扬眉吐气的机会。而且 DeepSeek 是开源的,大模型可以在本地运行。因此,开工的第一天,我就利用空余时间下载了各种参数的大模型并在本地跑了跑。

在这篇文章中,我主要分享了如何在本地运行 DeepSeek 以及如何避免遇到的坑。希望我的经验能对你有所帮助。

首先是去ollama官网去下载一下ollama,他是一个开源的 LLM(大型语言模型)服务工具https://ollama.com/

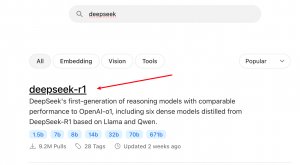

安装之后,打开ollama官网,上面有个搜索,直接搜deepseek,找到deepseek-r1

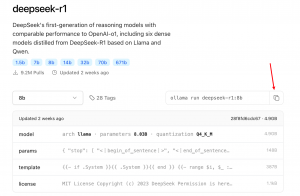

进去之后选择适合自己电脑的版本(一般的电脑跑个8b的差不多,32b的要3090+)

选完点击复制就可以了

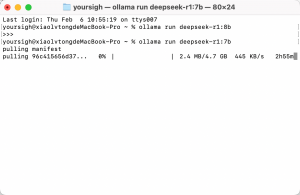

然后打开终端,windows用win+r输入cmd,mac在应用里面找终端

然后把刚刚复制的代码粘进去(我这里已经下过8b的了,所以用7b演示一下)

坑点来了:如果你发现下载速度变得很慢很慢(几十k这种),此时可以ctrl+c把这个停掉,然后再把复制的代码粘进来回车进行运行,你会发现速度会恢复到刚开始的极速状态,反复操作都是可以的,进度不会丢失(断点续传哈哈哈)

下完之后就可以开始对话了,输出速度还是可以的

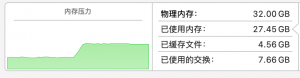

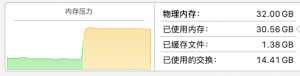

我这台电脑是M4芯片+32g内存的MacBookPro,所以跑这个8b的模型还是可以的

跑32b的话就有点慢了,内存也快吃满了

以上是终端上面跑本地大模型,如果你需要更好看的界面的话可以往下看:

可视化的话我选择了Open Web UI,这个界面还是挺好看的

使用这个有两种方式,一种是用python,另外一种是用docker,我这里用的是docker,首先去docker官网去下载一下https://www.docker.com/

装好之后首先用

docker -v

看看自己的docker有没有装好,这里显示版本号就是装好了

然后输入这串

docker run -d -p 3000:8080 \

--add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:main

之后本地打开http://localhost:3000/

就能看到可视化的界面啦,左上角还可以切换模型。